流程圖

再怎麼簡單的構念,有圖比沒圖好

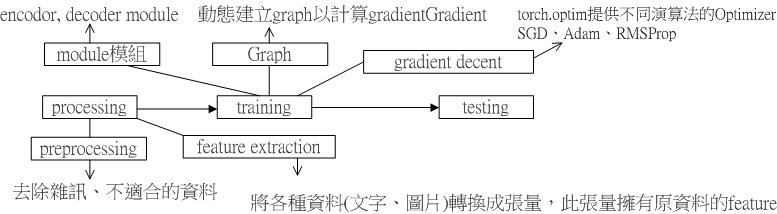

Fig.1 Schematic of Pytorch chatbot code structure.

使用深度學習的框架去訓練(train)一個model時,通常有三個主要步驟:處理資料Processing、訓練Training、測試Testing

處理資料:

處理資料包含預處理preprocessing與特徵抽取feature extraction。

preprocessing 是資料預處理,目的是去除除雜訊、或是不適合拿來train的資料。

feature extraction是將各種資料(文字、圖片)轉換成張量,此張量擁有原資料的feature。

訓練(training):

訓練包含三個元素:module模組、Graph、gradient decent。

module模組:就seq2seq model為例,module分成encoder、decoder部分。

Graph:pytorch會動態建立graph以計算gradient

Gradient decent:模式的參數是利用gradient decent的方式來更新。

Pytorc的torch.optim提供不同演算法的optimizer來做gradient decent,包括SGD、Adam、RMSProp。

將底色去掉,需有黑白版本的圖

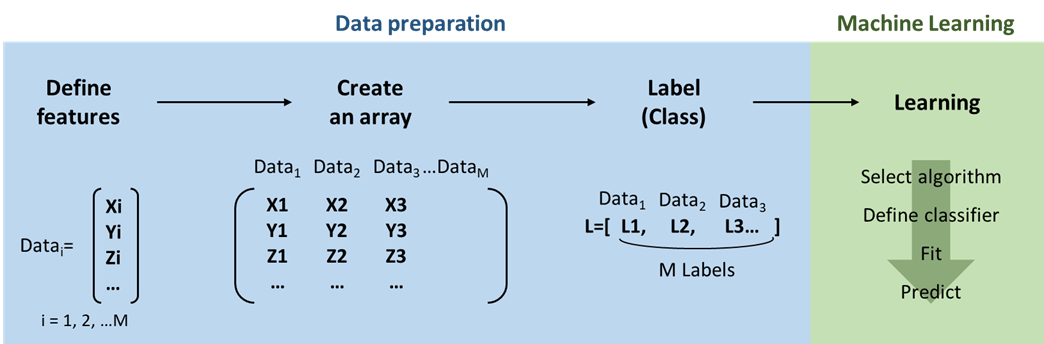

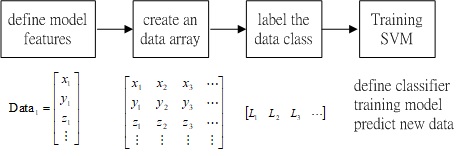

Fig.01 The procedure of conducting Linear SVC in this article

每個task,都有flowchart

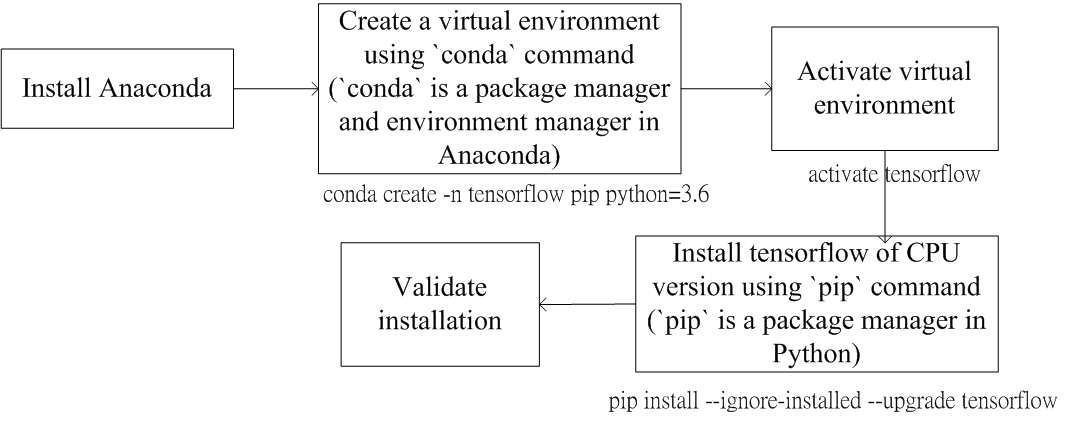

Fig.1 Flowchart of TensorFlow of CPU version installation.

Fig.1 Flowchart of TensorFlow of CPU version installation.